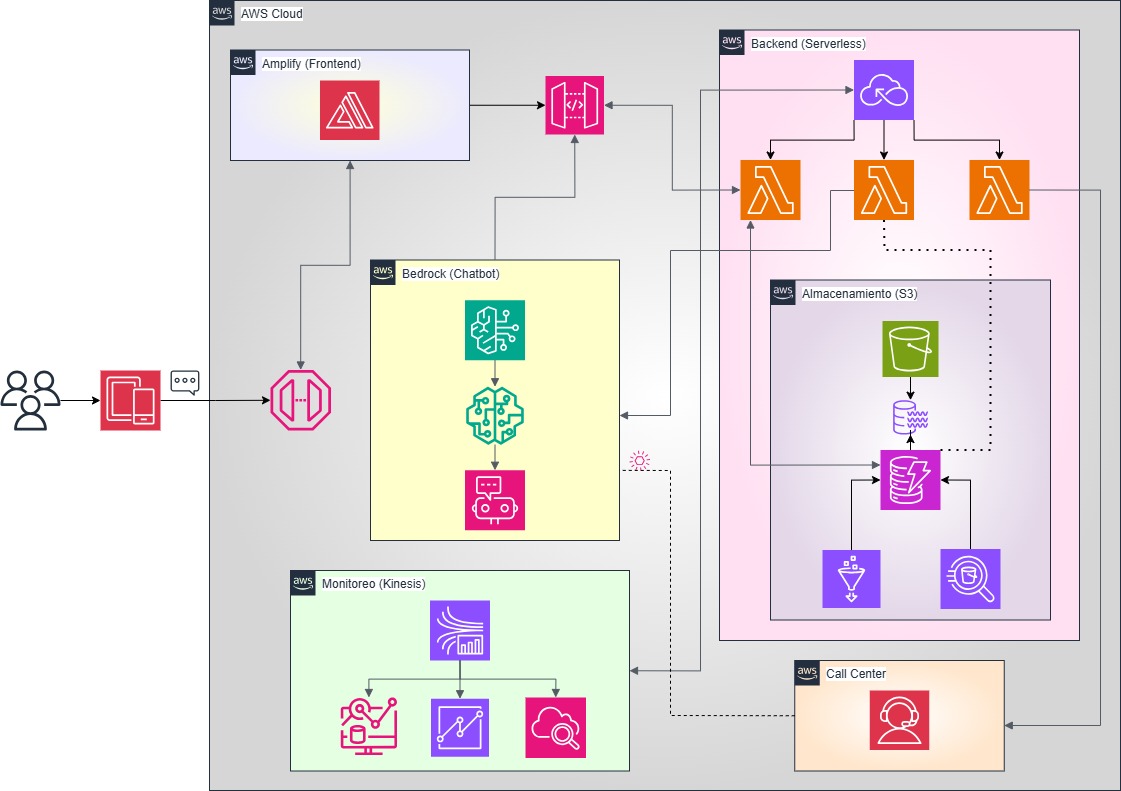

Arquitectura AWS GenAI para Call Center

Diseño arquitectónico de una solución empresarial para la automatización de atención al cliente utilizando Inteligencia Artificial Generativa en la nube. La propuesta implementa un ecosistema Serverless en AWS que resuelve el 80% de las incidencias mediante modelos RAG y gestiona inteligentemente la transferencia a agentes humanos, optimizando costos operativos y experiencia de usuario.

1. El reto: escalabilidad y costos

El cliente requería modernizar su centro de soporte técnico para manejar picos de demanda sin incrementar linealmente la plantilla de personal. Los sistemas tradicionales de chatbots basados en reglas eran insuficientes para entender consultas complejas.

El objetivo fue diseñar una arquitectura que redujera la saturación de las líneas telefónicas y ofreciera respuestas inmediatas 24/7, manteniendo un control estricto sobre el presupuesto de infraestructura.

Como arquitecto de soluciones, la decisión de utilizar un ecosistema Serverless (Lambda, Bedrock) frente a servidores tradicionales (EC2) no fue solo técnica, sino financiera. Se realizó un análisis de costo-beneficio que proyectó una reducción del 40% en costos operativos, ya que el negocio solo paga por el tiempo de cómputo exacto utilizado durante las llamadas al call center.

2. Arquitectura Serverless y RAG

Diseñé una solución basada en eventos utilizando AWS Lambda y API Gateway para garantizar una escalabilidad automática (scale-to-zero) y un modelo de pago por uso.

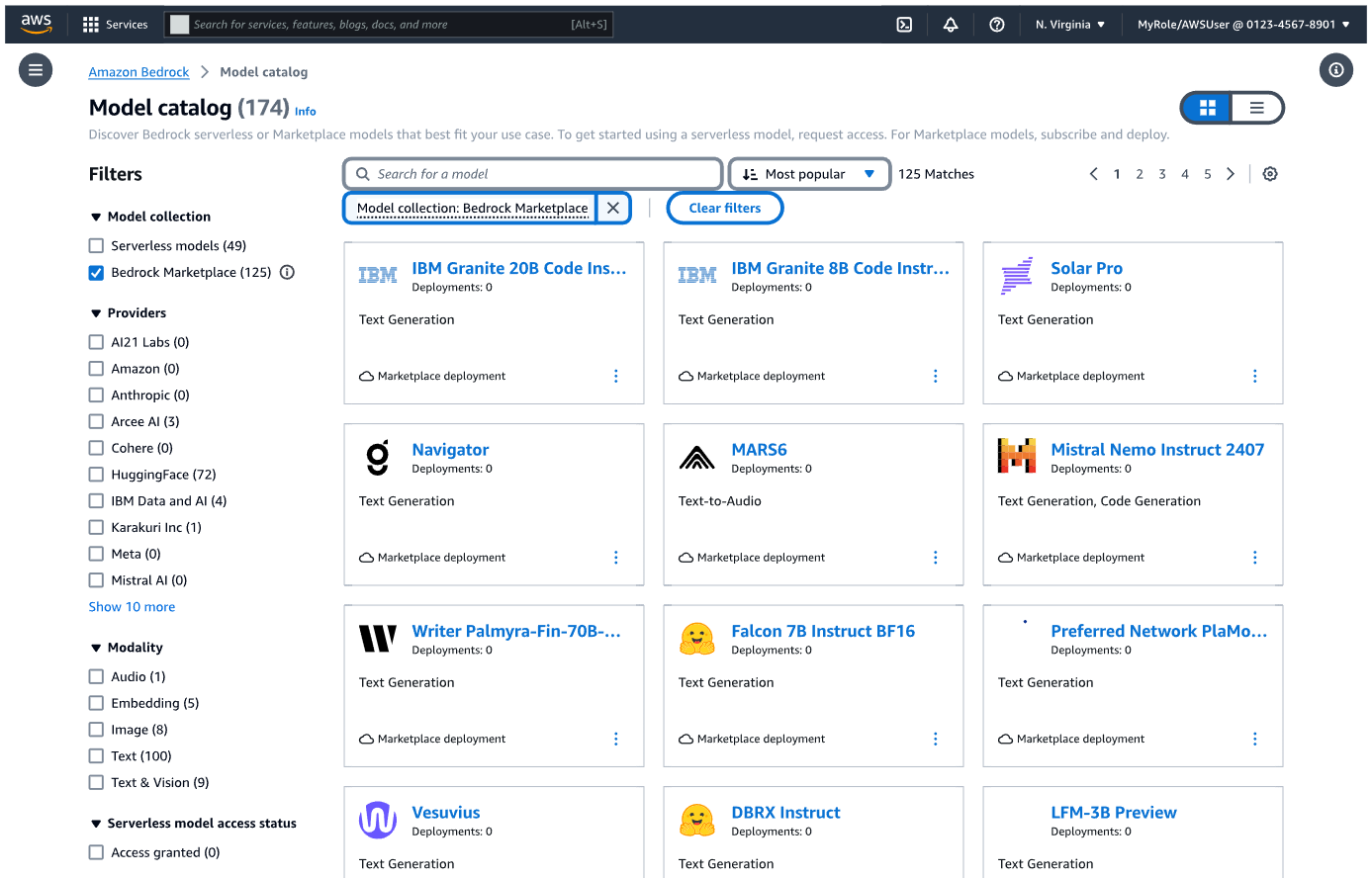

El núcleo de inteligencia utiliza Amazon Bedrock para acceder a modelos fundacionales (LLMs como Claude o Titan). Para evitar alucinaciones, estructuré una arquitectura RAG (Retrieval-Augmented Generation), conectando el modelo con bases de conocimiento en DynamoDB y S3, asegurando respuestas basadas estrictamente en los manuales técnicos de la empresa.

3. Estrategia 'Human-in-the-Loop'

La arquitectura no busca reemplazar al humano, sino potenciarlo. Diseñé un flujo lógico de clasificación de incidentes:

• Nivel L1 (IA): resolución automática de consultas frecuentes y procesos guiados.

• Nivel L2/L3 (Humano): si la IA detecta baja confianza o complejidad técnica, el sistema realiza un 'handover' transparente a un agente humano, transfiriendo el contexto completo de la conversación para evitar repeticiones.

4. Viabilidad financiera (FinOps)

Uno de los entregables clave fue el análisis detallado de costos operativos. Al utilizar una arquitectura Serverless en lugar de instancias EC2 fijas, se proyectó una reducción significativa en gastos de cómputo inactivo.

Se estimó un costo promedio de $0.02 USD por interacción completa, demostrando una viabilidad económica superior frente a los costos de licenciamiento de software SaaS tradicionales y la contratación de personal para turnos nocturnos.